Appearance

大模型 Token 服务

一、平台概述

济南人工智能大模型工场是一站式 AI 服务平台,提供大模型部署、调用与管理能力。当前已接入多款主流大模型与向量嵌入模型,支持通过标准 OpenAI 兼容接口进行调用。

二、支持模型列表

1. 语言模型(LLM)

| 模型 ID | 模型名称 | 上下文长度 | 语言 | 能力 | 模型描述 |

| qwen3-32B | Qwen3-32B | 40k | en/zh | 对话、推理、混合专家、工具调用 | Qwen3 是通义千问系列最新一代大语言模型,提供密集型与混合专家(MoE)模型组合,在推理、指令遵循、智能体能力与多语言支持上实现突破性进展。 |

| qwen3-14B | Qwen3-14B | 40k | en/zh | 对话、推理、混合专家、工具调用 | 同 Qwen3-32B,为 14B 参数版本,资源占用更低,适合轻量化部署场景。 |

| deepseek-r1-distill-qwen | DeepSeek-R1-Distill-Qwen | 128k | en/zh | 对话 | 由 DeepSeek-R1 蒸馏而来,基于 Qwen 架构,高效支持长上下文对话。 |

| deepseek-r1-distill-llama | DeepSeek-R1-Distill-Llama | 128k | en/zh | 对话 | 由 DeepSeek-R1 蒸馏而来,基于 Llama 架构,高效支持长上下文对话。 |

| deepseek-r1-0528-qwen3 | DeepSeek-R1-0528-Qwen3 | 128k | en/zh | 对话 | DeepSeek-R1 minor 版本升级,当前版本为 0528,在推理与对话能力上显著优化。 |

| DeepSeek-V3.1 | DeepSeek-V3.1 | 128k | en/zh | 对话 | 混合模式模型,同时支持思考模式与非思考模式,兼顾推理效率与响应速度。 |

| DeepSeek-V3.2 | DeepSeek-V3.2 | 160k | en/zh | 对话、推理、智能体 | 平衡高计算效率与卓越推理能力,适合复杂任务与长上下文场景。 |

| glm-4.7(后续支持) | GLM-4.7 | 128k | en/zh | 对话、代码 | 进一步增强 Interleaved Thinking,引入 Preserved Thinking 与 Turn-level 思考能力,是优秀的代码伙伴。 |

| Qwen3-VL-Instruct(后续支持) | Qwen3-VL-Instruct | 256k | en/zh | 多模态对话 | Qwen3 系列当前最强视觉 - 语言模型,支持图文理解与生成。 |

2. 嵌入模型(Embedding)

| 模型 ID | 模型名称 | 维度 | 最大 Token 数 | 语言 | 描述 |

| bge-m3 | BGE-M3 | 1024 | 8192 | zh/en | 强大的多语言向量嵌入模型,支持长文本编码,广泛应用于检索、聚类、语义匹配等场景。 |

三、API 调用说明

1. 基础信息

服务地址:https://www.sdagi.cn:7998

认证方式:Bearer Token(需在大模型工场平台获取 API Key)

接口规范:兼容 OpenAI Chat Completions API

2. 文本对话接口(Chat Completions)

接口:POST /v1/chat/completions

请求头

Content-Type: application/json

Authorization: Bearer sk-你的API密钥

请求参数:

| 名称 | 类型 | 必填 | 说明 |

| model | string | 是 | 模型 ID,如 qwen3-32B |

| messages | array | 是 | 对话消息列表,格式见下文 |

| max_tokens | int | 否 | 最大生成 Token 数量 |

| temperature | float | 否 | 采样温度,0~2 之间,值越小输出越确定 |

| top_p | float | 否 | 核采样概率,0~1 之间,与 temperature 二选一修改 |

| stream | bool | 否 | 是否流式输出,默认 false |

| frequency_penalty | float | 否 | 频率惩罚,-2.0~2.0,降低重复内容 |

| presence_penalty | float | 否 | 存在惩罚,-2.0~2.0,鼓励新主题 |

| stop | array | 否 | 停止词列表,最多 16 个 |

| response_format | object | 否 | 指定输出格式,如 |

messages 消息格式:

| 名称 | 类型 | 必填 | 说明 |

| role | string | 是 | 角色:system/user/assistant/tool |

| content | string | 是(user/system) | 消息内容 |

Curl 示例(非流式)

curl -X POST https://www.sdagi.cn:7998/v1/chat/completions

-H "Content-Type: application/json"

-H "Authorization: Bearer sk-你的API密钥"

-d '{

"model": "qwen3-32B",

"messages": [{"role": "user", "content": "你好"}]

}'

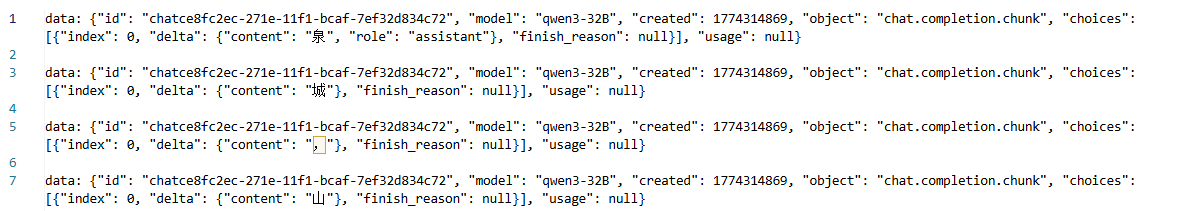

请求图示(非流式)

响应示例

{

"id": "chat4520ab40-2681-11f1-bcaf-7ef32d834c72",

"object": "chat.completion",

"created": 1774247208,

"model": "qwen3-32B",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"content": "你好!很高兴见到你 😊 今天过得怎么样呀?..."

},

"finish_reason": "stop"

}

],

"usage": {

"prompt_tokens": 13,

"completion_tokens": 47,

"total_tokens": 60

}

}

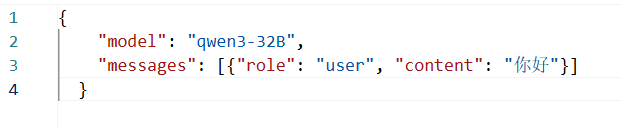

响应图示(非流式)

Curl 示例(流式)

将 stream设为 true,响应将以 SSE 形式逐段返回:

curl -X POST https://www.sdagi.cn:7998/v1/chat/completions

-H "Content-Type: application/json"

-H "Authorization: Bearer sk-你的API密钥"

-d '{

"model": "qwen3-32B",

"messages": [{"role": "user", "content": "10个字介绍济南"}],

"stream": true

}'

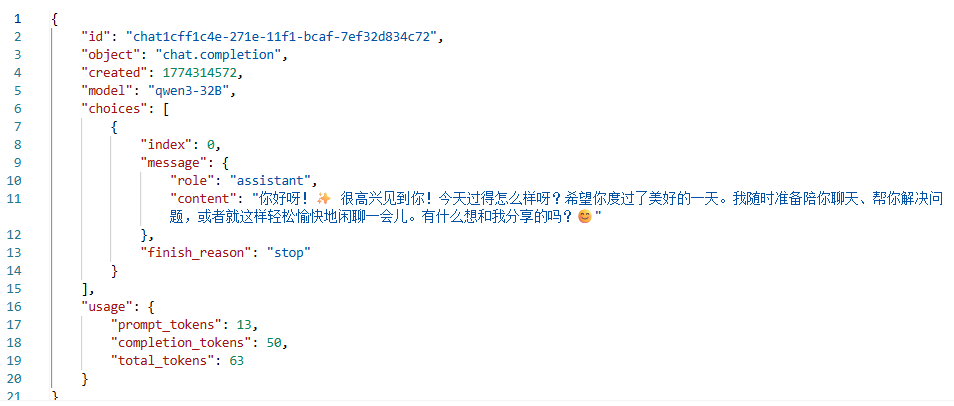

请求图示(流式)

流式响应片段示例

data: {"id":"...","object":"chat.completion.chunk","created":...,"model":"qwen3-32B","choices":[{"index":0,"delta":{"content":"泉城"},"finish_reason":null}]}

data: {"id":"...","object":"chat.completion.chunk","created":...,"model":"qwen3-32B","choices":[{"index":0,"delta":{"content":"风光秀丽"},"finish_reason":null}]}

data: [DONE]

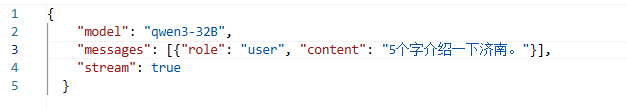

响应图示(流式)